Um was geht es?

Das chinesische Start-up DeepSeek hat mit seinem neuen KI-Modell «DeepSeek R1» für Aufsehen gesorgt. Dieses Sprachmodell von DeepSeek basiert auf einem Open-Source-Ansatz, während OpenAI die genaue Funktionsweise von ChatGPT geheim hält. Obwohl der Name «OpenAI» Offenheit vermuten lässt, ist ihr Code nicht öffentlich zugänglich. DeepSeek hingegen hat erklärt, wie es sein Modell mit deutlich geringeren Kosten entwickelt hat – nur einem Bruchteil dessen, was US-Unternehmen für ähnliche KI-Systeme ausgeben.

DeepSeek R1 wurde mit einer Vielzahl von Quellen trainiert, darunter öffentliche Webseiten und wissenschaftliche Datenbanken, die von herkömmlichen Suchmaschinen oft nicht erfasst werden. Das Modell ist kostenlos verfügbar und hat in kurzer Zeit die Download-Charts erobert.

Was ist so sensationell daran?

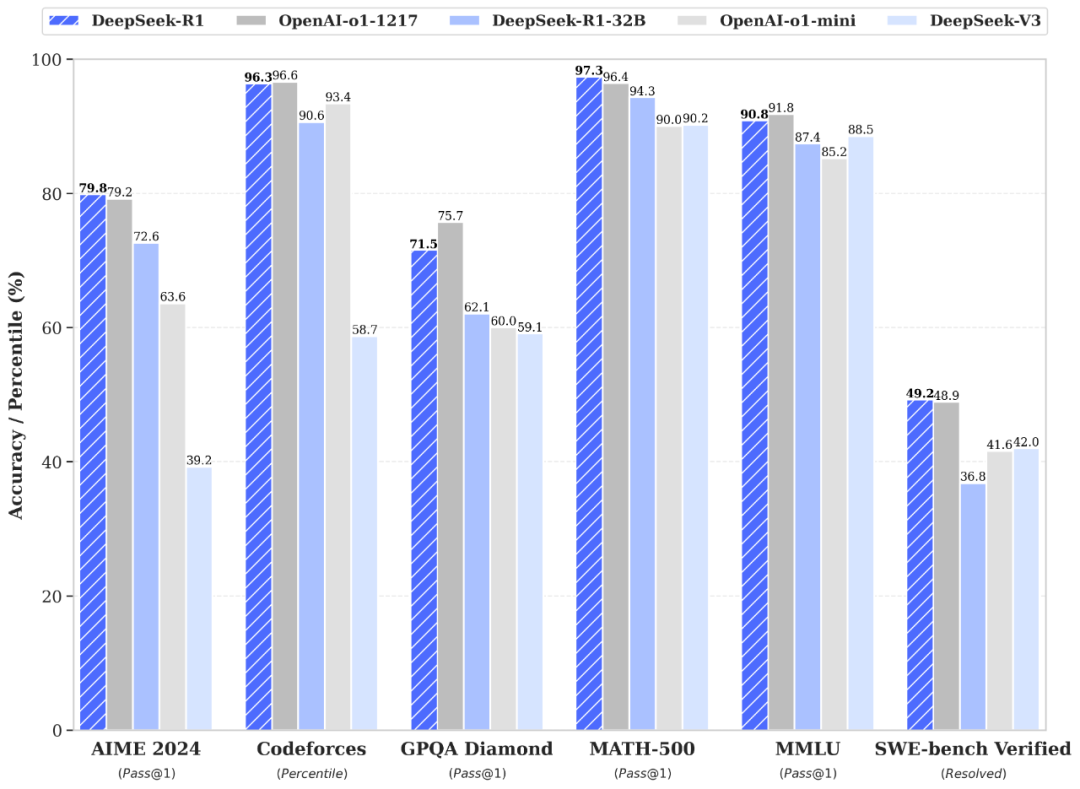

DeepSeek R1 beeindruckt durch seine Leistungsfähigkeit und Effizienz. In verschiedenen Benchmark-Tests übertrifft es etablierte Modelle wie ChatGPT O1 von OpenAI in mehreren Disziplinen, arbeitet dabei jedoch zu weit geringeren Kosten. Marc Andreessen, ein einflussreicher Tech-Investor im Silicon Valley, bezeichnete DeepSeek R1 als «einen der erstaunlichsten und beeindruckendsten Durchbrüche» und als «tiefgreifendes Geschenk an die Welt».

Ein weiterer bemerkenswerter Aspekt ist die Effizienz in der Entwicklung. DeepSeek investierte lediglich rund 5,6 Millionen Dollar in die Entwicklung von R1 und nutzte dabei leistungsschwächere KI-Chips. Im Vergleich dazu investieren grosse Tech-Konzerne wie OpenAI oder Meta oft das Zehnfache an finanziellen Mitteln und setzen auf leistungsstärkere Hardware. Diese Effizienz könnte das Geschäftsmodell der etablierten Anbieter infrage stellen.

Ein Benchmark im KI-Kontext ist ein standardisierter Bewertungstest, der verwendet wird, um die Leistungsfähigkeit von KI-Systemen in verschiedenen Disziplinen / Aufgaben objektiv zu messen und zu vergleichen.

- AIME 2024 (Pass@1) – misst die Genauigkeit bei mathematischen Aufgaben im AIME-Wettbewerb.

- Codeforces (Percentile) – bewertet die Leistung im kompetitiven Programmieren.

- GPQA Diamond (Pass@1) – testet die Genauigkeit bei komplexen Fragen.

- MATH-500 (Pass@1) – bewertet mathematische Problemlösung.

- MMLU (Pass@1) – misst das allgemeine Wissen und Problemlösung über viele Domänen hinweg.

- SWE-bench Verified (Resolved) – testet die Fähigkeit, Softwareentwicklungsaufgaben zu lösen.

Was bedeutet dies für die Zukunft von KI?

Der Erfolg von DeepSeek R1 könnte einen Paradigmenwechsel in der KI-Landschaft einleiten. Die Verfügbarkeit eines leistungsstarken Open-Source-Modells ermöglicht es Forschenden und Entwickler*innen weltweit, darauf aufzubauen und neue Anwendungen zu entwickeln. Dies könnte zu einer Beschleunigung von Innovationen und einer Demokratisierung des Zugangs zu fortschrittlicher KI-Technologie führen.

Allerdings wirft die Entwicklung auch Fragen auf. Die Tatsache, dass DeepSeek aus China stammt, könnte Bedenken hinsichtlich Datenschutz und staatlicher Kontrolle aufwerfen. Zudem zeigt der Erfolg von DeepSeek, dass auch mit begrenzten Ressourcen erhebliche Fortschritte in der KI-Entwicklung möglich sind, was den Wettbewerb in diesem Bereich intensivieren dürfte.

Welche Möglichkeiten gibt es für die Bildung?

DeepSeek R1 bietet im Bildungsbereich erhebliche Potenziale, die das Lehren und Lernen revolutionieren könnten. Durch seine fortschrittlichen Fähigkeiten und den Open-Source-Charakter ermöglicht es Bildungseinrichtungen und Lernenden weltweit, von seinen Funktionen zu profitieren.

Der Open-Source-Ansatz von DeepSeek R1 stellt sicher, dass nicht nur Eliteuniversitäten oder wohlhabende Länder von fortschrittlicher KI profitieren können. Auch Schulen und Organisationen in Regionen mit begrenzten Ressourcen erhalten Zugang zu dieser Technologie, was zu einer gerechteren Verteilung von Bildungsressourcen beitragen kann.

DeepSeek R1 kann offline verwendet werden, da es sich um ein Open-Source-Modell handelt, das lokal auf dem eigenen Computer installiert werden kann. Dies bietet den Vorteil, dass keine Internetverbindung erforderlich ist und alle Datenverarbeitungen ausschliesslich lokal stattfinden, was die Privatsphäre schützt. Allerdings benötigt das vollständige R1-Modell sehr viel Rechenleistung. Für Nutzer*innen mit begrenzter Hardware stehen jedoch sogenannte «Distilled»-Versionen von DeepSeek zur Verfügung, die weniger Ressourcen benötigen und dennoch eine gute Leistung bieten. Es gibt zudem Softwarelösungen wie LMStudio oder AnythingLLM, die eine einfache lokale Installation und Nutzung von DeepSeek mit einer benutzerfreundlichen Chatbot-Oberfläche ermöglichen. Mehr dazu kannst du im folgenden Video lernen:

Quellen:

da Silva, G., Wolf, P., Ariosa, L. & Büchenbacher, K. (2025). Ist Deepseek besser als Chat-GPT? Überholt China die USA im KI-Wettlauf? Antworten auf die wichtigsten Fragen zum Hype. [28.1.25]

Loser, P., Schüssler, M. & Spreiter, S. (2025). Mit Deepseek fordert China den Westen aufs Neue heraus. [30.1.25]

Mordrelle, E. (2025). Ist Deepseek besser als Chat-GPT? Überholt China die USA im KI-Wettlauf? Antworten auf die wichtigsten Fragen zum Hype. [30.1.25]

Schieb, J. (2025). DeepSeek: KI-Modell aus China als Alternative zu ChatGPT? [28.1.25]

Sullivan, A. (2025). Warum DeepSeek die KI-Welt und die Börse schockt. [30.1.25]

Tramèr, F. (2025). «Deepseek gehört zu den besten KI-Modellen». [30.1.25]

Zaugg, S. (2025). Deepseek lehrt US-Techgiganten das Fürchten. [30.1.25]